NVIDIA 用一個開源模型,讓所有人重新思考「大模型一定要大算力」這件事。

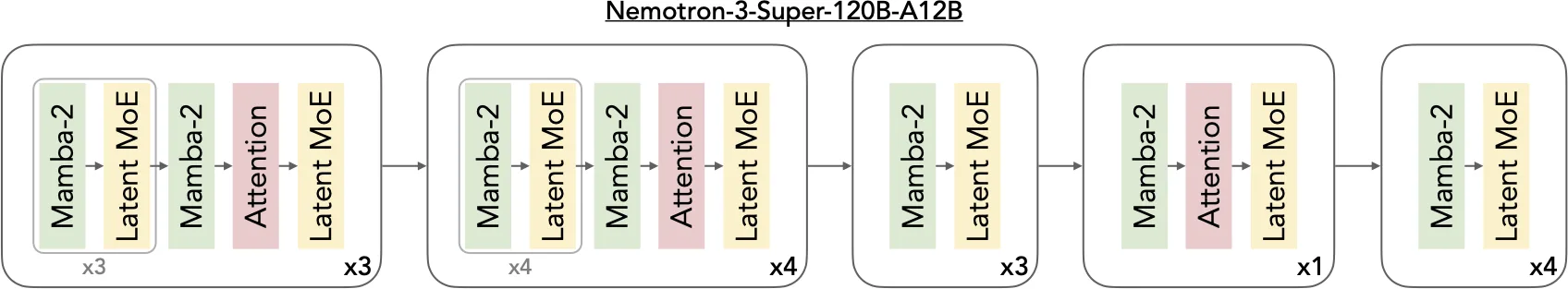

Mamba + Transformer + MoE:三合一架構

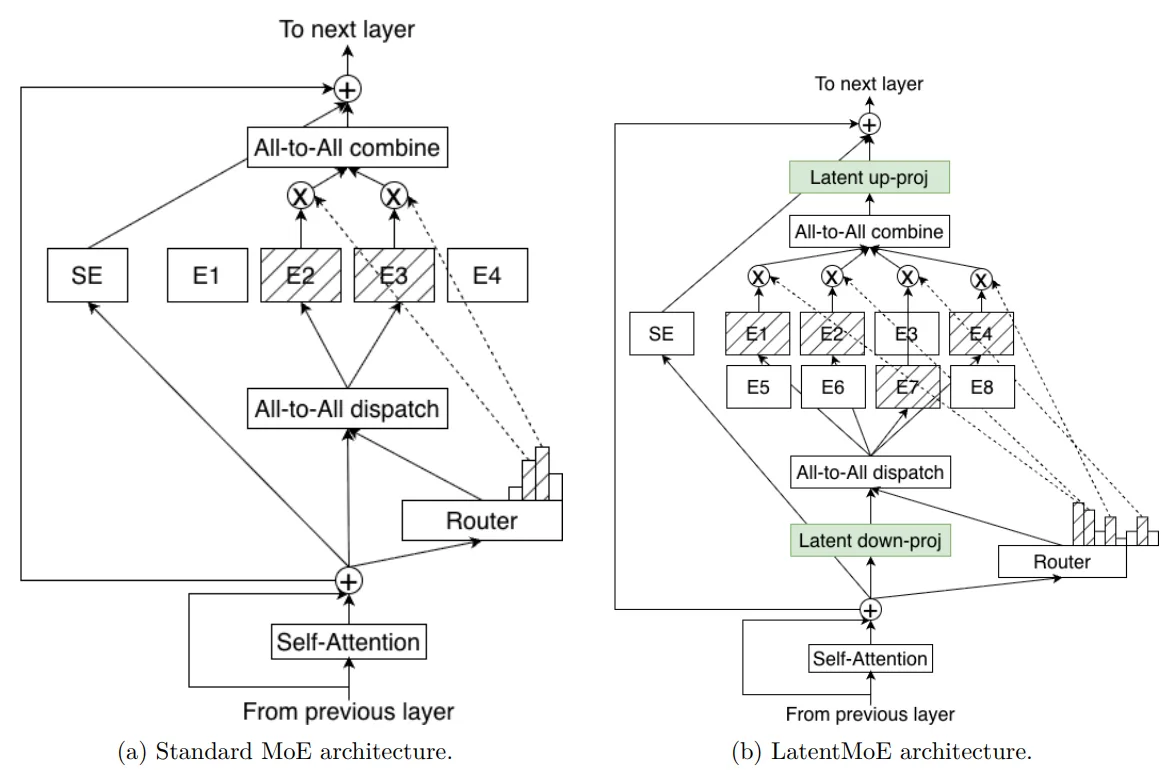

Nemotron 3 Super 最讓人眼睛一亮的,不是參數量本身,而是它的架構設計。它把 Mamba 的線性注意力機制、Transformer 的全局建模能力、以及 Mixture-of-Experts 的稀疏激活策略三者融合在一起。總參數量 120B,但每次推理只激活 12B——這意味著你用十分之一的計算資源,就能跑出接近全量模型的效果。

這不是一個漸進式改良,而是架構層級的突破。過去 MoE 模型的路由策略常被詬病不穩定,而 Mamba 在長序列上的表現又不如純 Transformer。NVIDIA 的工程團隊顯然花了大量功夫在架構調和上,讓三種機制各司其職:Mamba 處理長距離依賴、Transformer 負責精細推理、MoE 控制計算預算。

Multi-Token Prediction:推理速度直接乘以三

另一個殺手級特性是 Multi-Token Prediction(MTP)。傳統自回歸模型一次只預測下一個 token,MTP 讓模型一次預測多個 token,在不犧牲品質的前提下把推理速度拉高三倍。對於需要大量生成的場景——程式碼撰寫、長文翻譯、agent 規劃——這個加速幅度是實打實的生產力提升。

NVIDIA 同步釋出了完整的訓練流程和權重,採用開源授權。這代表研究者和企業都能直接在自己的硬體上部署,不需要依賴 API。

對開源社群的意義

過去一年,開源模型和閉源模型的差距不斷縮小,但在推理效率上始終存在落差。Nemotron 3 Super 補上了這塊拼圖。它證明了一件事:只要架構夠聰明,開源模型不需要燒掉天文數字的 GPU 小時,也能交出頂級表現。

如果你還在觀望要不要投入開源模型生態,現在是最好的時機。Nemotron 3 Super 不只是一個模型發布,它是開源 AI 從「追趕者」變成「定義者」的轉折點。12B 活躍參數就能打的時代,算力不再是唯一的護城河——架構才是。

更多 AI 新聞

追蹤 IG 第一時間收到 AI 新聞推播。