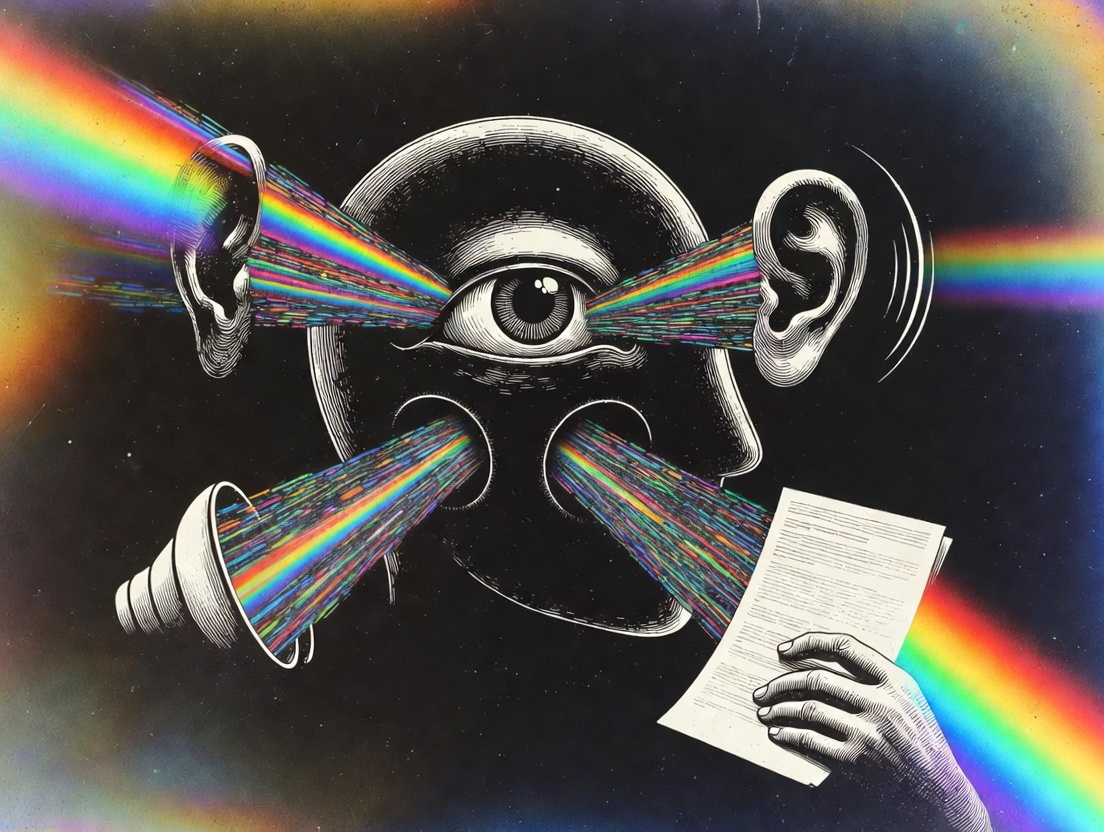

從只能打字聊天的 chatbot,到能同時看圖、聽聲音、操作電腦的 Agent——多模態 Agent 是 AI 從「對話工具」變成「行動夥伴」的關鍵跨越。

什麼是多模態 Agent?

傳統的 AI Agent 主要處理文字:讀指令、查資料、寫回覆。多模態 Agent 打破了這個限制——它同時處理文字、圖像、影片、語音,而且不只是「理解」這些資訊,還能據此「執行動作」。這就是 Vision-Language-Action(VLA)模型的核心概念:感知、推理、行動一氣呵成。

Springer Nature 發表的這篇綜述論文系統性地梳理了多模態 Agent 的完整技術棧:從底層的多模態感知(怎麼同時處理不同類型的資訊)、中層的推理與規劃(怎麼根據多種資訊來源做決策)、到上層的行動執行(怎麼把決策轉化為真實世界的操作)。這是目前最完整的多模態 Agent 學術綜述之一。

目前的技術突破

2026 年的多模態 Agent 已經不是實驗室玩具。MMaDA 和 EBind 等創新模型展示了跨越語言、視覺、音頻和 3D 空間的統一處理能力,在多項基準測試中超越了參數量更大的前代模型。這證明了多模態整合不只是「把不同模型拼在一起」,而是需要從架構層面重新設計。

實際應用場景已經非常具體:瀏覽器自動化(Agent 看著網頁畫面操作)、機器人控制(Agent 看著攝影機畫面決定動作)、醫療影像分析(Agent 同時讀取 X 光片和病歷文字)。這些不再是論文裡的 demo,而是正在部署的產品。

挑戰與未來方向

安全性是最大的隱憂。當 Agent 能操作電腦、控制機器人,它搞破壞的能力也同步提升。一個被駭的多模態 Agent 不只會說錯話,還可能執行有害的操作。論文花了大量篇幅討論安全邊界:哪些動作需要人類確認、怎麼偵測異常行為、如何建立有效的權限控制。

評估標準也是難題。文字模型可以用考試分數衡量,但多模態 Agent 要怎麼測?看網頁的準確度、操作電腦的成功率、理解語音的正確性——這些需要完全不同的評估框架。論文指出,建立標準化的多模態 Agent 評估基準,是推動這個領域前進的當務之急。具身智慧(Embodied Intelligence)——讓 Agent 從虛擬世界走進物理世界——則是更遠的終極目標。

當 AI 能同時看、聽、說、做,它就不再是工具,而是同事。多模態 Agent 是 AI 從助手進化為協作者的起點——但安全性和評估標準必須跟上,否則我們只是在打造一個更強大但更不可控的系統。

更多 AI 新聞

追蹤 IG 第一時間收到 AI 新聞推播。