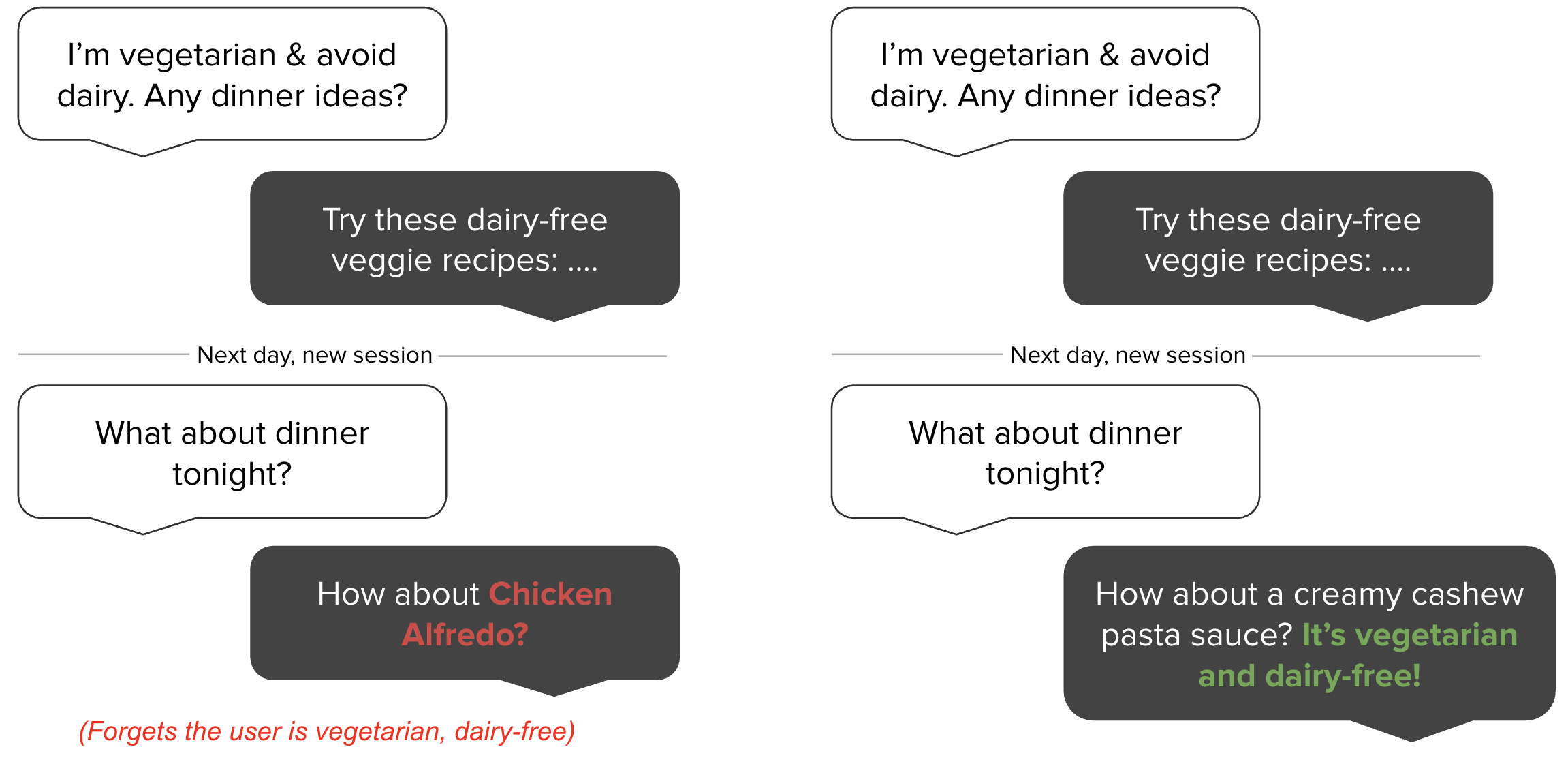

你跟 AI 聊過的偏好、做過的決定、提到的背景——下次對話它全部忘光。Mem0 要解決的就是這個問題:讓 AI 擁有真正的長期記憶。

問題在哪?

LLM 有固定的 Context Window(上下文視窗),超過就忘。目前的解法是把整段對話歷史塞進去,但這樣又慢又貴——延遲高、Token 成本爆炸。而且大部分歷史對話其實不重要,硬塞進去反而讓模型分心。

Mem0 的做法不一樣:它會動態地從對話中「萃取」重要資訊,整合成結構化記憶,需要時再「召回」。就像人類的記憶——不是記住每句話,而是記住重要的事。

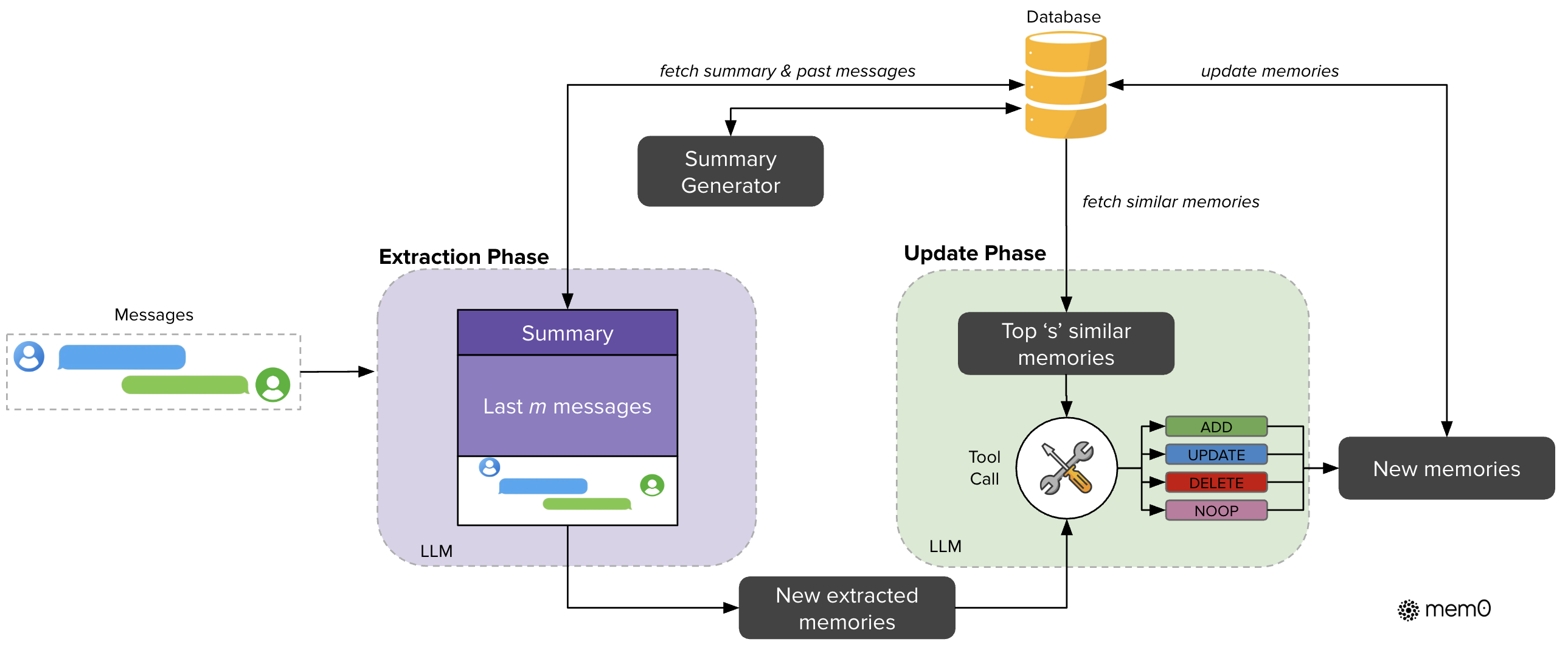

怎麼運作?

Mem0 的架構分兩階段:萃取階段——從對話中提取關鍵資訊(事實、偏好、決定);更新階段——將新資訊與既有記憶整合,處理衝突和過時資訊。召回時用語意搜尋找到最相關的記憶片段。

進階版 Mem0g 用圖結構(Graph)來存記憶,能捕捉實體之間的複雜關係。比如「你喜歡咖啡」和「你對咖啡因敏感」這兩條記憶會被關聯起來,讓 AI 的建議更有上下文。

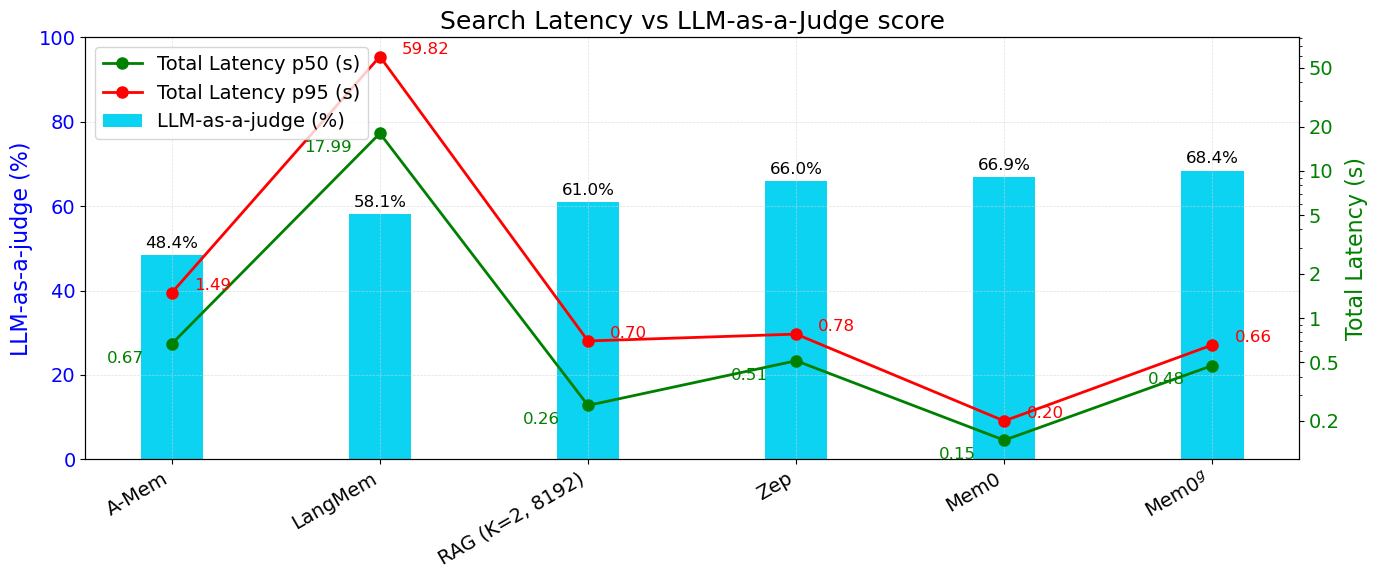

效果多好?

在 LOCOMO 基準測試上,Mem0 在四種問題類型(單跳、時間、多跳、開放領域)都打贏所有既有系統。比 OpenAI 的記憶方案提升 26%。圖記憶版本再多 2%。

更驚人的是效率:相比「把全部歷史塞進去」的暴力做法,Mem0 的 p95 延遲降低 91%,Token 成本省超過 90%。又準又快又便宜。

對你有什麼影響?

如果你用過 ChatGPT 的 Memory 功能覺得「還好但不夠」,Mem0 展示了記憶系統應該做到的水準。未來的 AI 助手應該像一個真正認識你的夥伴,記得你的偏好、理解你的背景、追蹤你的目標。

Mem0 是開源的,這意味著你可以自己部署、控制自己的記憶資料。隱私敏感的人不用擔心記憶存在別人的伺服器上。

Mem0 讓 AI 從「金魚腦」進化成「真正記得你的夥伴」。比 OpenAI 方案準 26%、延遲低 91%、成本省 90%——而且是開源的。

更多 AI 新聞

追蹤 IG 第一時間收到 AI 新聞推播。